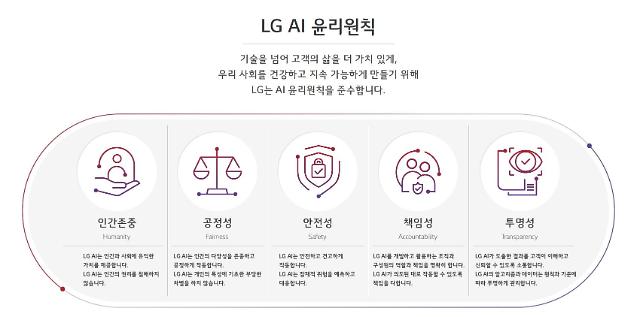

LG가 24일 발표한 인공지능(AI) 윤리원칙.[사진=LG]

[이코노믹데일리] LG가 인공지능(AI) 개발 과정에 윤리적 가치를 고려하는 'AI 윤리원칙'을 발표했다. 경영 이념인 고객 가치와 인간 존중을 토대로 '착한 AI' 개발에 집중하는 모습이다.

24일 LG에 따르면 AI 윤리원칙은 AI를 개발하고 활용하는 모든 구성원이 지켜야 할 가치 판단 기준이다. 이는 인간 존중, 공정성, 안전성, 책임성, 투명성 등 5가지로 구성됐다.

인간 존중은 AI가 인간의 자율성이나 존엄성 같은 권리를 침해하지 않고 인류에 긍정적인 가치를 제공할 수 있어야 한다는 원칙이다.

공정성은 AI가 성별·나이·장애 등 개인 특성에 따라 부당하게 차별하지 않고 다양성을 존중하며 공정하게 작동해야 한다는 원칙이다.

이밖에 안전과 관련한 글로벌 수준 검증 시스템을 항시 가동한다는 '안전성'과 구성원이 역할과 책임을 명시하는 '책임성', AI 알고리즘·데이터를 투명하게 관리하고 고객과 소통하는 '투명성' 등이 5대 원칙에 포함됐다.

LG는 AI 윤리원칙이 단순히 규제나 규율로 그치지 않도록 구체적인 실행 전략을 수립하기로 했다.

이에 따라 LG그룹 AI 연구 허브인 AI연구원은 최근 'AI 윤리 점검 태스크포스(TF)'를 신설했다. 이 TF는 LG 구성원을 대상으로 AI 윤리원칙 교육을 진행하고, AI로 발생 가능한 윤리 문제를 연구·개발 단계에서 검증하는 역할을 맡는다.

연말에는 그룹 내 LG전자를 비롯해 10개 계열사가 참여하는 윤리 문제 협의체인 'AI 윤리 워킹그룹'이 출범할 예정이다.

LG는 AI 윤리 점검 TF와 워킹그룹에서 축적한 데이터, 사례를 바탕으로 세부 분야별 윤리 가이드라인을 개발해 2023년까지 계열사로 전파한다는 계획이다.

LG AI연구원은 특히 상담 챗봇 등 AI 서비스를 이용하는 소비자가 혐오·차별적 표현을 경험하지 않도록 혐오 표현 방지 기술을 연구 중이다. 문장의 맥락까지 분석해 공격적이거나 편향된 정보를 걸러내고 사회적 갈등을 줄인다는 취지다.

이와 함께 AI가 내놓은 결과값이 도출된 근거와 오류 발생 원인을 인간이 알기 쉽게 설명하는 '설명 가능한 AI'를 개발해 수요 예측 모델과 맞춤형 면역 항암 치료제 예측 모델 개발 등에 활용 중이다.

배경훈 LG AI연구원장은 "인간이 AI를 어떻게 바라보고 활용하느냐에 따라 가치에 대한 평가는 달라질 것'이라며 "LG는 윤리원칙을 수립해 인간과 AI의 공존에 대해 연구를 지속하고 고객 가치를 창출해 나가겠다"라고 말했다.

댓글 더보기